2017 年底(dǐ),国外(wài)论坛出现的一个ID 为“deepfakes”的用户发布了通过机器学习来更换(huàn)视频人脸的人工智能(néng)算(suàn)法,一(yī)脚踢开了人工智能换脸大(dà)门(mén)。不过当时该技术的(de)使用门槛还比较高(gāo),需要(yào)编译代码(mǎ)等操作。

而一(yī)个月后,有人将他公开的的算法加以改造推出简易版人工智能(néng)换脸工具“FakeApp”,这次,就(jiù)算是普通用户(hù),也能(néng)够顺利操作。

随(suí)着换脸技术的升(shēng)级及(jí)相关应用的(de)开源,换脸用(yòng)途也从最初的娱乐逐渐演变成犯罪工具,引发了人(rén)们越来越多对人工智能换脸(liǎn)的担忧。

首先是(shì)对于信息的真实(shí)性形成(chéng)严峻的挑战。PS 发明(míng)后(hòu),有(yǒu)图(tú)不(bú)再有真相;而(ér)人工智能换脸技(jì)术(shù)的出(chū)现,则让图像也(yě)开(kāi)始变得镜花水月了起来:这(zhè)对于本来就(jiù)假消息满天(tiān)飞的互联网来说,无疑会造成进一步(bù)的信任(rèn)崩(bēng)坏(huài)。

其次(cì),这会大大增加侵犯(fàn)肖像权的可能,没(méi)人愿意自己的脸(liǎn)庞出现在莫名其妙的视频当中,此前就有在某成人视频(pín)网站上,某女(nǚ)星(xīng)的脸(liǎn)被“安”在(zài)了成人视频女主角脸上的(de)报道(dào),这(zhè)将给女星的名誉带来极大(dà)的负面(miàn)影响。

鉴于这项技术所带来的伦理问(wèn)题和潜在(zài)威胁,先进的 DeepFake 检测(cè)技术将非常重要。

在以前(qián)的研究中,DeepFake 视频检测主要专(zhuān)注(zhù)于(yú)在具备强监督标注的情况下(xià),如何较(jiào)好地检(jiǎn)测到 DeepFake 图像或者人脸。

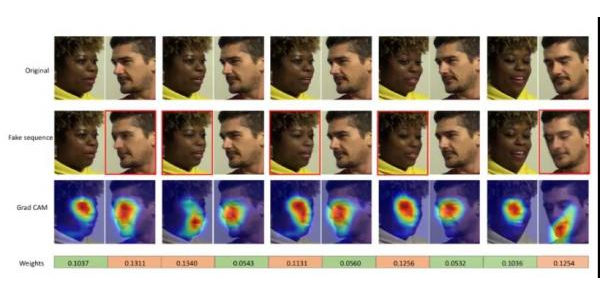

现在(zài),阿里安全(quán)图灵实(shí)验(yàn)室和中科院计算所合作完成的一项研究更加关注现(xiàn)实中广泛存在的(de)问题:部(bù)分(fèn)攻击(篡改)的视频,即(jí)视频(pín)中只(zhī)有部(bù)分人脸被篡改了(le)。

具体来(lái)说,该(gāi)研究提出了基于多实例(lì)学(xué)习(xí)的 DeepFake 检测(cè)框架(jià),将人脸(liǎn)和输入视频分别当作多实例学习 (Multiple Instance Learning, MIL) 里的实(shí)例和(hé)包进(jìn)行检测。

然而,传(chuán)统的多实例学习存在梯度消失问题。为此,研(yán)究(jiū)人(rén)员提出了 Sharp-MIL (S-MIL),将(jiāng)多个实例的聚合由输出层(céng)提(tí)前(qián)到(dào)特征层,一方(fāng)面使得聚合(hé)更加灵(líng)活,另一方面也利用伪(wěi)造检测的目标函(hán)数直(zhí)接(jiē)指导实例级深度表征的学习,从而缓解传统多(duō)实例(lì)学习面临的梯度消失难题(tí)。该研究通过理论证明了 S-MIL 可(kě)以缓解传统 MIL 存在的梯(tī)度消失问题(tí)。

研究(jiū)人员表(biǎo)示,除了部(bù)分换脸检测(cè)任务之外,该研(yán)究成果对于(yú)一般性的(de)视(shì)频多实例学习与标注技术研(yán)究也具有(yǒu)重要的启发意义(yì),而(ér)人工(gōng)智能换脸技术及其检测(cè)技术也值得我们持续关注。